Home

Profile

Name: Elon Musk @elonmusk

Bio: The people voted for major government reform

Tweets

Elon Musk (@elonmusk)

2026-06-05 00:58:55.980289971 +0800 CST

成功的codex跳过手机验证的方案:1.登录chatgpt网页,开通高级安全设置,会提供恢复密码,2.后续申请恢复密码登录,等48 小时后,就不会再跳手机验证。目前已成功一个账号

Elon Musk (@elonmusk)

2026-05-31 08:15:33.829118909 +0800 CST

https://openai.com/zh-Hans-CN/form/codex-for-oss/

Elon Musk (@elonmusk)

2026-05-29 01:59:31.11863223 +0800 CST

https://developers.openai.com/api/docs/guides/secure-mcp-tunnels

Elon Musk (@elonmusk)

2026-05-18 21:26:55.260284867 +0800 CST

https://x.com/fantuantalk/status/2054915572551516405

Elon Musk (@elonmusk)

2026-05-17 23:13:32.235654181 +0800 CST

https://github.com/anthropics/financial-services针对我们最常接触的金融服务工作流(包括投资银行、股票研究、私募股权和财富管理),提供相应的参考代理、技能和数据连接器。此处的所有内容均可通过单一来源以两种方式获取:将其安装为 Claude Cowork 插件,或通过您自有工作流引擎背后的 Claude Managed Agents API 进行部署。系统提示和技能完全一致——您只需选择运行位置即可。

Elon Musk (@elonmusk)

2026-05-17 16:51:26.197383699 +0800 CST

Cloudflare Tunnel:零成本给 localhost 一个公网身份https://x.com/eternityspring/status/2055867694298419451

Elon Musk (@elonmusk)

2026-05-16 21:17:05.699074996 +0800 CST

今天分享:Codex App使用第三方中转,也可登录ChatGPT 昨天codex App可远程控制后,使用中转到的朋友们肯定急的抓嘴挠腮简单2步,解决烦恼前提:使用任意GPT账号登录1. 修改 auth.json: "auth_mode": "chatgpt", "OPENAI_API_KEY":null2.修改config.toml:```model_provider = "xai" [model_providers.xai] name = "xai" base_url = "https://api.xairouter.com" experimental_bearer_token = "xxx" requires_openai_auth = true [features]remote_connections = trueremote_control = true ```接下来,就是见证神奇的一刻,你的插件,Codex Mobile都可使用!

Elon Musk (@elonmusk)

2026-05-01 03:07:55.868712004 +0800 CST

https://blog.cloudflare.com/agents-stripe-projects/?utm_campaign=cf_blog&utm_content=20260429&utm_medium=organic_social&utm_source=twitter

Elon Musk (@elonmusk)

2026-05-01 03:04:00.756415578 +0800 CST

https://github.com/cloudflare/agentic-inbox

Elon Musk (@elonmusk)

2026-04-29 17:29:36.666164433 +0800 CST

https://developers.openai.com/codex/ide

Elon Musk (@elonmusk)

2026-04-25 05:30:56.148902554 +0800 CST

https://xairouter.com/blog/codex-gpt-5-5-xai-router/

Elon Musk (@elonmusk)

2026-04-24 02:11:23.765615337 +0800 CST

https://developers.openai.com/api/docs/pricing?latest-pricing=standard

Elon Musk (@elonmusk)

2026-04-23 18:55:05.321853476 +0800 CST

第三方 API 也可以用上 Claude Desktop 和 Cowork 了!之前只能用官方订阅的账号1. 打开 Claude Desktop/Cowork,不要登录 2. 点击 菜单栏的Help → Troubleshooting → Enable developer mode 启用开发者模式3.启用后会看到一个 Developer 菜单,点击 Developer 然后 Configure third-party inference 配置第三方 API4.填入 Base URL 和 API Key,选择 Apply locally 等待重新启动启动完之后就可以正常使用了,对于不喜欢用 Cluade Code终端的人来说,GUI 的桌面端非常友好现在也可以在 Claude Desktop 和 Cowork 中使用第三方 API 了!此前仅支持官方订阅账号。1. 打开 Claude Desktop/Cowork,无需登录2. 点击菜单栏的 Help → Troubleshooting → Enable developer mode 启用开发者模式3. 启用后会出现一个 Developer 菜单,点击 Developer,然后选择 Configure third-party inference 配置第三方 API4. 填写 Base URL 和 API Key,选择 Apply locally,等待重启重启完成后即可正常使用。对于不喜欢使用 Claude Code 终端的用户来说,图形化桌面端非常友好。

Elon Musk (@elonmusk)

2026-04-21 23:57:11.36881615 +0800 CST

Elon Musk (@elonmusk)

2026-04-18 11:33:02.608697564 +0800 CST

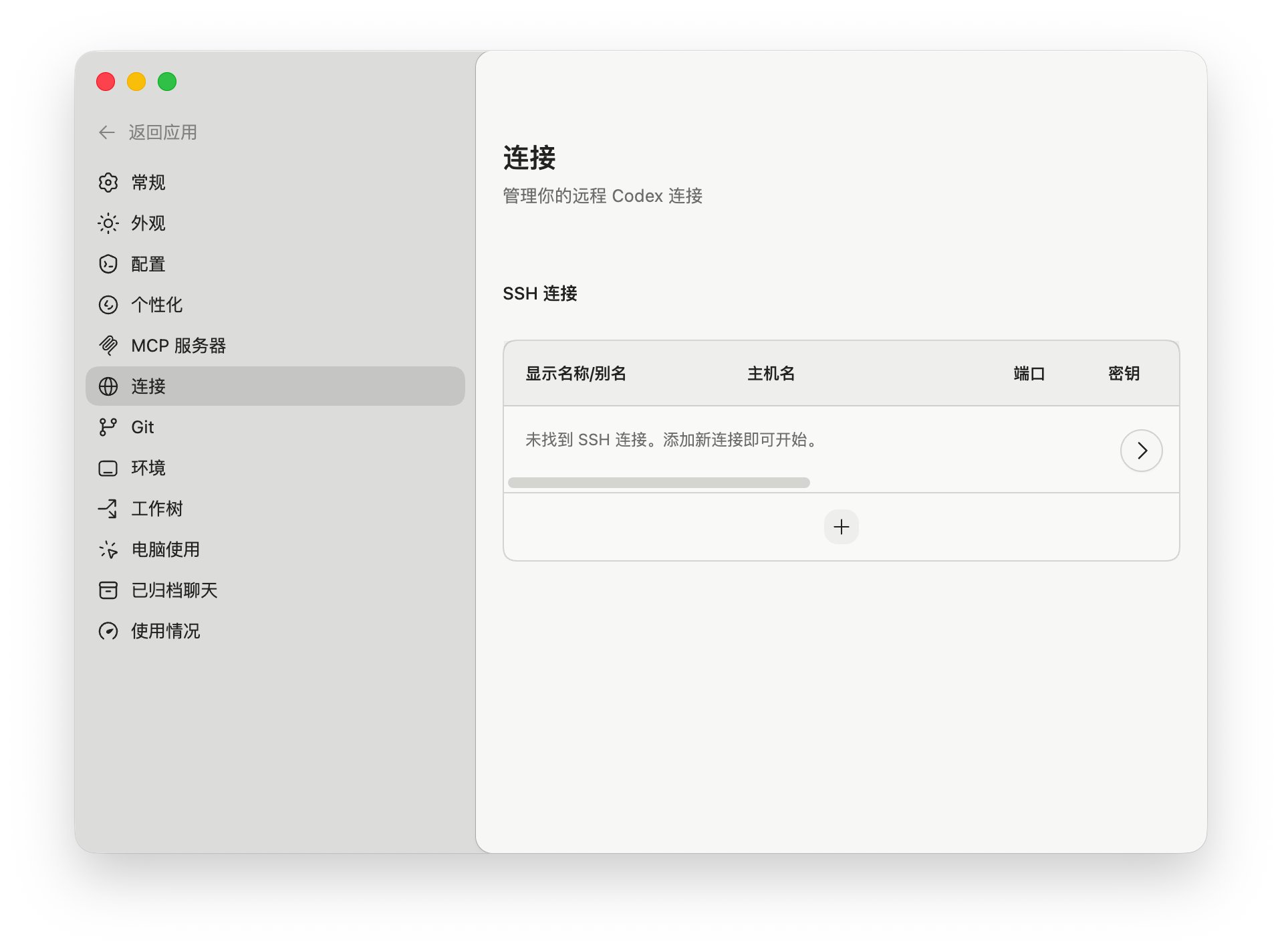

新版的Codex Desktop APP已经原生支持通过 SSH 连接到远程开发环境了特别适合你的工作依赖于不在你的笔记本电脑上的环境的情况。以防你不知道,以下是开启方法:把这一串```[features] remote_connections = true```放到这个里面~/.codex/config.toml然后在Codex APP里面点击设置,点击连接就有这个功能了

Elon Musk (@elonmusk)

2026-04-14 10:43:48.905780498 +0800 CST

xairouter.com 用了都说好

Elon Musk (@elonmusk)

2026-04-12 06:36:54.317983233 +0800 CST

https://xairouter.com/blog/enterprise-xai-router/

Elon Musk (@elonmusk)

2026-04-11 09:00:08.700684434 +0800 CST

Codex CLI 0.119.0 已发布 📋 现在按 Ctrl+O 可将上次的代理回复以 Markdown 格式复制——任何地方都可用,甚至在 SSH 连接下也支持。我一直在不间断地使用它来获取计划以便审查。

Elon Musk (@elonmusk)

2026-04-09 15:01:45.668693924 +0800 CST

https://tuta.com

Elon Musk (@elonmusk)

2026-04-07 23:47:40.605220686 +0800 CST

Redis 作者分享的一个真实实验对比过去一周,他用 Claude Code Opus 4.6 和 Codex GPT 5.4(max thinking)进行了长时间的自主运行,在独立的目录环境中反复测试。任务非常复杂,从一个早期90年代的 Unix 磁盘镜像,反向工程早已消失的 SCSI 控制器及其集成 ROM。这是为了计算机历史和博物馆合作的项目,需要结合硬件知识、汇编/反汇编等深度工程能力。实验结果:GPT 5.4 :在多次长时间运行中取得了所有主要进展,能有效混合硬件知识、反汇编技巧等,完成复杂逆向工作。Claude Opus 4.6:只取得了少量次要进展,在高难度任务上几乎一点用都没有。他的结论:对于高难度的工程工作,两者差距非常残酷。GPT 5.4 明显更强,尤其在需要深度推理和长时程任务时。

Elon Musk (@elonmusk)

2026-04-07 23:44:28.260231456 +0800 CST

npm install -g @openai/codex oh-my-codexomx setupomx --madmax --high

Elon Musk (@elonmusk)

2026-04-06 17:42:24.345284273 +0800 CST

AI 时代的"工作证":Agent Auth 是什么?https://x.com/SaitoWu/status/2040813138917134457

Elon Musk (@elonmusk)

2026-04-06 10:37:31.019160919 +0800 CST

Elon Musk (@elonmusk)

2026-04-02 16:29:48.663980923 +0800 CST

https://xairouter.com/blog/rtk-xai-router-token-savings/

Elon Musk (@elonmusk)

2026-04-01 21:18:15.974117547 +0800 CST

https://github.com/rtk-ai/rtk一个面向 AI 编程代理的命令行代理层/输出压缩器,不是业务系统。它的核心目标是夹在“代理”和“真实 CLI”之间,把 git status、cargo test、grep、docker logs 这类原本很长的输出压缩成更适合 LLM 消化的版本,从而减少 token 消耗和上下文噪音

Elon Musk (@elonmusk)

2026-04-01 13:18:15.852615432 +0800 CST

https://www.bleep-it.com

Elon Musk (@elonmusk)

2026-03-30 11:34:40.808544349 +0800 CST

https://github.com/atrosinenko/qemujs

Elon Musk (@elonmusk)

2026-03-24 12:05:58.344121323 +0800 CST

https://github.com/icebear0828/codex-proxy

Elon Musk (@elonmusk)

2026-03-18 19:13:02.484024578 +0800 CST

https://github.com/opendataloader-project/opendataloader-pdf

Elon Musk (@elonmusk)

2026-03-17 12:57:01.927823454 +0800 CST

https://developers.openai.com/codex/subagents

Elon Musk (@elonmusk)

2026-03-16 00:55:02.453690804 +0800 CST

https://github.com/golutra/golutra

Elon Musk (@elonmusk)

2026-03-15 23:56:11.017138813 +0800 CST

3个月457个PR|看OpenAI团队如何把Skills写代码用到极致https://x.com/tvytlx/status/2033105336463482924https://developers.openai.com/blog/skills-agents-sdk

Elon Musk (@elonmusk)

2026-03-15 22:14:30.72033323 +0800 CST

https://github.com/deusyu/translate-book/tree/main

Elon Musk (@elonmusk)

2026-03-15 22:09:38.247240955 +0800 CST

Elon Musk (@elonmusk)

2026-03-15 21:52:18.516660605 +0800 CST

过去两周,GitHub上增长最快的AI开源项目盘点(除OpenClaw外):Agency Agents — 35K+ 把Claude Code一键变成51位AI专家+9大部门的完整团队,从产品、开发、设计到营销、社媒、QA全流程覆盖。相当于免费雇了一整家AI公司。https://github.com/msitarzewski/agency-agents Auto Research — 25K Karpathy刚开源的"科研实习生机器人"。你给它一个目标,它自动规划实验、改代码、跑训练、看结果、再优化,循环往复。睡一觉醒来,最优版本已经准备好了。https://github.com/karpathy/autoresearch Lightpanda — 14K+ 首个专为AI和自动化设计的无头浏览器。不基于Chromium,完全从零构建,运行速度比Chrome快11倍,内存占用少9倍。大规模爬取和AI Agent开发的利器。https://github.com/lightpanda-io/lightpanda llmfit — 14K+ 一条命令帮你找到哪些大模型适合在自己的电脑上本地部署跑起来,还会对模型的质量、速度、适配性和上下文维度进行评分。告别盲目下载几十GB模型却发现跑不动的尴尬。https://github.com/10ran/llmfit CLI-Anything — 3.5K+ (仅3天)港大新开源,一行命令让任意软件秒变AI Agent可控工具——GIMP、Blender、LibreOffice、OBS Studio全部拿下。发布3天就登上GitHub Trending榜单,增速惊人。https://github.com/HKUDS/CLI-AnythingCLI-Anything — 3.5K+(仅 3 天)港大新开源,一行命令让任意软件秒变 AI Agent 可控工具——GIMP、Blender、LibreOffice、OBS Studio 全部拿下。发布 3 天就登上 GitHub Trending 榜单,增速惊人。 https://github.com/HKUDS/CLI-Anything SpacetimeDB 2.0 — GitHub+HackerNews双爆号称比传统数据库快1000倍的实时数据库,把数据库和服务器合成一个东西:客户端直接连数据库,数据变化实时推送到所有客户端。最骚的演示:用它做了视频通话,所有数据通过数据库实时同步传输。https://github.com/clockworklabs/SpacetimeDB Cognee — 自改进Skill系统不只是存Skill,而是让Skill能观察自己的执行历史、检查失败原因、自动修正优化。Skill从静态prompt文件变成会进化的活系统,解决了"Skill用久了失效"的根本问题。https://github.com/topoteretes/cognee

Elon Musk (@elonmusk)

2026-03-15 10:19:05.886025145 +0800 CST

xaicontrol.com

Elon Musk (@elonmusk)

2026-03-15 10:18:05.355577852 +0800 CST

如果你想要了解 AI 编程代理的工作原理,这是一份绝佳的资源。《学习 Claude Code》从零开始逐步讲解如何构建一个极简版的 Claude Code 代理,详细解释了每个机制的实现过程。你将看到大多数编程代理共有的核心循环:调用模型、执行工具、反馈结果并迭代。这是一种清晰的方式,帮助你真正理解这些系统是如何构建的。 https://learn-claude-agents.vercel.app

Elon Musk (@elonmusk)

2026-03-13 00:39:13.435449068 +0800 CST

五年前,几乎没人听说过“智能合约工程师”。今天,它已经是 Web3 的高薪岗位之一,月薪 3 万起。而同样的机会窗口,正在再次打开。这一次,它的名字叫 ERC-8183。3月10日,这个标准悄悄落地了。没几个人注意到它。先说它解决了什么问题——AI Agent 要互相做生意了。 Agent A 要雇 Agent B 做设计。但问题来了: A 说"你先交货" B 说"你先付款"没有平台、没有合同、没有法律—— 怎么办?ERC-8183 的答案: 💰 钱锁进智能合约 📦 B 完成交付 ⚖️ 第三方 Evaluator 验收(可以是另一个 AI) ✅ 合约自动结算,没有人能耍赖每完成一笔,记录自动写入 Agent 的链上信誉档案——AI 世界的"职业履历"就这样一单单积累起来。Ethereum Foundation + Virtuals Protocol 联手打造。 以太坊基金会与 Virtuals 协议联手打造。EF AI 负责人 Crapis 说:这是 Agent 开放经济最后缺失的一块拼图。拼图补齐之后: 🪪 ERC-8004 — Agent 有了身份和信誉💸 x402 — Agent 有了支付通道 🤝 ERC-8183 — Agent 有了交易规则一套完整的 AI 经济底层,就在以太坊上跑通了。这套规则谁来写?谁来审?谁来维护?不是 OpenAI,不是 Google—— 正是现在入场的你。就像当年很少有人意识到,智能合约工程师会成为 Web3 的核心岗位。今天,“AI Agent 规则制定者”这个角色,甚至还没有正式的名字。

Elon Musk (@elonmusk)

2026-03-12 02:42:37.279705932 +0800 CST

PI 与 OpenClaw 深度整合架构分析https://x.com/servasyy_ai/status/2031584215507288318

Elon Musk (@elonmusk)

2026-03-11 23:00:04.351886664 +0800 CST

OpenAI 公开了他们用 Codex 维护 Agents SDK 的完整方案,值得每个 AI agent 用户学一遍。核心结构只有四层:1. AGENTS.md — 强制触发规则,用 if/then 写清楚什么情况必须调哪个 workflow2. .agents/skills/ — 封装具体工作流,每个 skill 一件事、一个触发条件、一个输出3. scripts/ — 固定顺序的 shell 操作放这里,不让模型每次重新猜4. Codex GitHub Action — 本地稳定了就搬进 CI,逻辑完全复用还有一个容易忽视的细节:skill 里 description 字段是路由信号,不是注释。写模糊了 agent 就不知道该用哪个 skill。他们的建议是——路由不准先改 description,别加代码。把这套思路推广开来:任何项目,只要把工程规范显式编码进仓库,agent 的行为就会稳定得多。示例仓库:https://github.com/openai/openai-agents-python原文:https://developers.openai.com/blog/skills-agents-sdk

Elon Musk (@elonmusk)

2026-03-11 22:59:45.497191924 +0800 CST

https://hermes-agent.nousresearch.com

Elon Musk (@elonmusk)

2026-03-11 22:54:58.181250943 +0800 CST

LLMs 中的分页注意力机制,清晰解释!https://x.com/_avichawla/status/2031624056072712547

Elon Musk (@elonmusk)

2026-03-11 22:54:31.181822424 +0800 CST

https://github.com/luoling8192/software-design-philosophy-skill

Elon Musk (@elonmusk)

2026-03-10 23:50:14.560989612 +0800 CST

https://xaicontrol.com/blog/xai-router-xai-control-combo/

Elon Musk (@elonmusk)

2026-03-10 01:08:41.86442542 +0800 CST

The Execution Layerhttps://x.com/RhysSullivan/status/2030903539871154193

Elon Musk (@elonmusk)

2026-03-08 13:24:25.338688824 +0800 CST

https://github.com/yologdev/yoyo-evolve

Elon Musk (@elonmusk)

2026-03-07 17:18:27.87013719 +0800 CST

这便是 Perplexica,一个完全免费、可直接在本地运行的 AI 搜索引擎。主打零 API 成本、零数据收集,所有操作完全在你的设备上跑。核心特性如下:- 实时联网:直接搜索并整合全网最新信息。- 精准溯源:提供的每一个回答都会标注信息源出处。- 本地驱动:兼容对接 Ollama,支持本地运行各种大语言模型。- 多种模式: 内置通用、学术、YouTube、Reddit 和写作等专属搜索模式。GitHub:https://github.com/ItzCrazyKns/Perplexica

Elon Musk (@elonmusk)

2026-03-07 15:45:51.393478775 +0800 CST

工程技术:在智能体优先的世界中利用 Codexhttps://openai.com/zh-Hans-CN/index/harness-engineering/

Elon Musk (@elonmusk)

2026-03-07 13:40:42.906380341 +0800 CST

https://blog.rust-lang.org/2026/03/05/Rust-1.94.0/

Elon Musk (@elonmusk)

2026-03-06 11:15:44.357125546 +0800 CST

https://ampcode.com/news/gpt-5.4-the-new-oracle

Elon Musk (@elonmusk)

2026-03-06 07:24:44.123585949 +0800 CST

```model = "gpt-5.4"model_reasoning_effort = "xhigh"personality = "pragmatic"service_tier = "fast"model_context_window= 1000000model_auto_compact_token_limit = 900000suppress_unstable_features_warning = true```

Elon Musk (@elonmusk)

2026-03-06 00:29:02.746084835 +0800 CST

How To Be A World-Class Agentic Engineerhttps://x.com/systematicls/status/2028814227004395561

Elon Musk (@elonmusk)

2026-03-06 00:27:59.675673438 +0800 CST

Perplexity Computer 深度解析:Sandbox Matrix 维护机制与快速任务执行的技术内幕https://x.com/xds2000/status/2029433337895653466

Elon Musk (@elonmusk)

2026-03-05 11:53:09.26684073 +0800 CST

OpenClaw养成记,从0开始!安装后必看!(40天实战经验+含角色提示词)https://x.com/berryxia/status/2028668902465733084

Elon Musk (@elonmusk)

2026-03-05 11:00:34.917225652 +0800 CST

https://xairouter.com/blog/codex-app-install-config-guide/

Elon Musk (@elonmusk)

2026-03-04 15:06:06.86261972 +0800 CST

https://xairouter.com/blog/xai-router-codex-cloud-claude-quickstart/

Elon Musk (@elonmusk)

2026-03-03 12:56:56.250604748 +0800 CST

你的代理需要的是一个 harness,而不是一个框架https://x.com/djfarrelly/status/2028556984396452250

Elon Musk (@elonmusk)

2026-03-02 16:42:09.69814151 +0800 CST

Elon Musk (@elonmusk)

2026-03-02 16:32:52.879232574 +0800 CST

https://jina.ai

Elon Musk (@elonmusk)

2026-03-02 14:24:06.905468719 +0800 CST

https://arxiv.org/abs/2210.03629

Elon Musk (@elonmusk)

2026-03-02 11:50:01.141421441 +0800 CST

https://github.com/chenhg5/cc-connect 花10分钟就可以在微信飞书钉钉连接上你的claudecode/codex/geminicli/cursor 从此实现随时随地大小码

Elon Musk (@elonmusk)

2026-03-02 10:42:34.272846303 +0800 CST

💻 GitHub:github.com/blockrunai/clawrouter

Elon Musk (@elonmusk)

2026-03-01 19:50:09.259560316 +0800 CST

https://openai.com/index/harness-engineering/

Elon Musk (@elonmusk)

2026-03-01 19:48:58.78221664 +0800 CST

https://github.com/semos-labs/attyx

Elon Musk (@elonmusk)

2026-03-01 19:40:22.063379106 +0800 CST

https://mnt.io/articles/about-memory-pressure-lock-contention-and-data-oriented-design/

Elon Musk (@elonmusk)

2026-03-01 19:37:42.719248657 +0800 CST

https://github.com/GoogleCloudPlatform/kubectl-ai

Elon Musk (@elonmusk)

2026-03-01 18:10:06.628730587 +0800 CST

https://github.com/ossu/computer-science

Elon Musk (@elonmusk)

2026-03-01 18:07:11.625964793 +0800 CST

https://github.com/fastclaw-ai/fastclaw

Elon Musk (@elonmusk)

2026-03-01 18:02:55.211316181 +0800 CST

https://github.com/lahfir/agent-desktop

Elon Musk (@elonmusk)

2026-03-01 18:02:09.43009519 +0800 CST

https://github.com/RightNow-AI/openfang

Elon Musk (@elonmusk)

2026-03-01 16:59:51.896572062 +0800 CST

https://github.com/raphaelmansuy/edgequake

Elon Musk (@elonmusk)

2026-03-01 15:09:24.964744216 +0800 CST

design tweaks for context+github: https://github.com/ForLoopCodes/contextpluswebsite: https://contextplus.vercel.app

Elon Musk (@elonmusk)

2026-03-01 15:06:24.058551216 +0800 CST

我们如何构建安全、可扩展的代理沙箱基础设施https://x.com/larsencc/status/2027225210412470668

Elon Musk (@elonmusk)

2026-03-01 15:03:55.616814301 +0800 CST

一个简单易用的框架,用于构建即开即用的智能体系统https://x.com/neural_avb/status/2027721962479288566

Elon Musk (@elonmusk)

2026-03-01 12:41:42.771725137 +0800 CST

https://github.com/second-state/qwen3_asr_rs

Elon Musk (@elonmusk)

2026-03-01 12:15:05.556331613 +0800 CST

https://www.middlefun.com

Elon Musk (@elonmusk)

2026-03-01 12:03:09.295809701 +0800 CST

https://github.com/hehehai/voxt

Elon Musk (@elonmusk)

2026-03-01 11:03:49.404584082 +0800 CST

https://github.com/ylytdeng/wechat-decrypt

Elon Musk (@elonmusk)

2026-03-01 02:48:35.359229615 +0800 CST

```# 写代码时随手跑make clippy # warn 不阻断, 快速反馈# 提 PR / 合并前make lint # fmt + clippy# 发版 / 上线前make release-check # fmt-check + test + clippy-ci(全deny) + audit # 任一步失败立即终止# 确认没问题make docker-build # 打包发布```

Elon Musk (@elonmusk)

2026-03-01 01:43:42.993869432 +0800 CST

https://help.router-for.me

Elon Musk (@elonmusk)

2026-02-28 13:23:22.904600624 +0800 CST

https://openai.com/zh-Hans-CN/index/amazon-partnership/

Elon Musk (@elonmusk)

2026-02-28 13:14:01.902228979 +0800 CST

https://github.com/K-Dense-AI/claude-scientific-skills

Elon Musk (@elonmusk)

2026-02-28 12:41:35.304113535 +0800 CST

https://magpie-lang.com

Elon Musk (@elonmusk)

2026-02-28 12:38:40.820115036 +0800 CST

https://developers.openai.com/codex/multi-agent/

Elon Musk (@elonmusk)

2026-02-28 00:12:17.381728963 +0800 CST

人生的第一个五年计划2026-2030

Elon Musk (@elonmusk)

2026-02-27 22:53:15.254818981 +0800 CST

WiFi 实现监控你在家的一举一动,不用摄像头、不用传感器、更不需要什么特殊硬件。https://github.com/ruvnet/wifi-densepose

Elon Musk (@elonmusk)

2026-02-27 21:28:11.755361107 +0800 CST

https://xairouter.com/blog/xai-router-openai-websocket-mode/

Elon Musk (@elonmusk)

2026-02-27 15:53:43.562584108 +0800 CST

https://github.com/Gen-Verse/OpenClaw-RL

Elon Musk (@elonmusk)

2026-02-27 14:54:28.909267837 +0800 CST

https://github.com/afterxleep/agents

Elon Musk (@elonmusk)

2026-02-27 14:50:00.466270639 +0800 CST

https://github.com/duanyytop/agents-radar/issues/11

Elon Musk (@elonmusk)

2026-02-27 14:47:44.559839541 +0800 CST

https://developers.openai.com/codex/changelog

Elon Musk (@elonmusk)

2026-02-27 12:42:13.746534363 +0800 CST

https://github.com/RightNow-AI/openfang

Elon Musk (@elonmusk)

2026-02-27 10:41:08.060615233 +0800 CST

https://llmgateway.io

Elon Musk (@elonmusk)

2026-02-27 10:00:23.418879305 +0800 CST

Codex,用大白话讲https://x.com/gabrielchua/status/2026832978056458383

Elon Musk (@elonmusk)

2026-02-27 00:30:32.980169942 +0800 CST

CODEX 多智能体手册https://x.com/LLMJunky/status/2027032974202421336

Elon Musk (@elonmusk)

2026-02-26 23:22:55.382781261 +0800 CST

https://www.perplexity.ai/computer/live/

Elon Musk (@elonmusk)

2026-02-26 18:51:37.346144141 +0800 CST

https://memctl.com/

Elon Musk (@elonmusk)

2026-02-26 18:44:01.685633538 +0800 CST

https://github.com/mjovanc/sigshare

Elon Musk (@elonmusk)

2026-02-25 22:28:41.992805908 +0800 CST

https://zeroclaw.org/zh

Elon Musk (@elonmusk)

2026-02-25 20:46:41.512329577 +0800 CST

https://bankofai.io